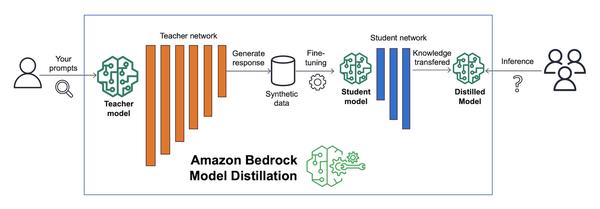

Amazon Web Services (AWS) ha anunciado nuevas actualizaciones para Guardrails for Amazon Bedrock, diseñadas para mejorar la seguridad y confiabilidad de las aplicaciones de IA generativa. Estas actualizaciones incluyen la detección de alucinaciones y una API independiente para fortalecer las aplicaciones con barreras de seguridad personalizadas en cualquier modelo, lo que garantiza resultados responsables y confiables.

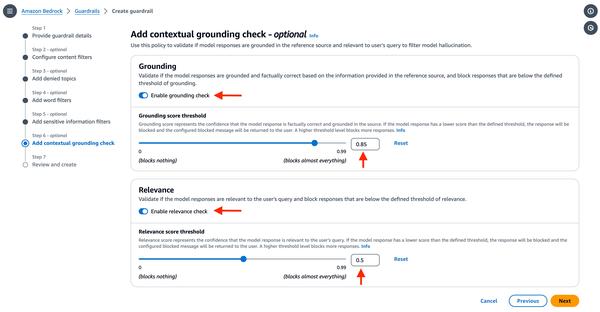

La función de detección de alucinaciones es una adición valiosa, ya que permite a los clientes verificar la precisión de las respuestas del modelo en función de una fuente de referencia y la consulta del usuario. Esto ayuda a garantizar que el modelo no genere información incorrecta o novedosa que no se base en datos fácticos.

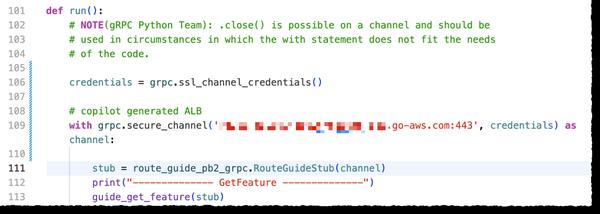

La API ApplyGuardrail permite a los clientes evaluar las entradas del usuario y las respuestas del modelo con respecto a las medidas de seguridad configuradas. Esta función es particularmente útil para organizaciones que utilizan LLM autogestionados o de terceros, ya que les permite aplicar medidas de seguridad estandarizadas en todas sus aplicaciones.

Con estas actualizaciones, AWS reafirma su compromiso de proporcionar herramientas y soluciones que permitan a los clientes crear aplicaciones de IA generativa seguras y confiables. Guardrails for Amazon Bedrock es un paso significativo en esta dirección, que ofrece a los clientes un mayor control sobre el comportamiento de los LLM que utilizan.

Los clientes interesados en obtener más información sobre estas nuevas funciones pueden visitar la página del producto Guardrails for Amazon Bedrock en el sitio web de AWS.